人工智能的警世预言 埃隆·马斯克与科学界如何警示公共安全数据风险

以埃隆·马斯克为代表的科技领袖和众多前沿科学家频繁发出警告,指出人工智能(AI)的快速发展,特别是其对公共数据的深度介入,可能对公共安全秩序构成潜在威胁。这一观点并非危言耸听,而是基于对技术轨迹、社会结构和伦理困境的深刻洞察。

人工智能的核心驱动力是数据,尤其是大规模的公共数据。从城市监控网络、交通管理系统到社交媒体行为和公共卫生记录,AI系统正以前所未有的规模吸收、分析和利用这些信息,以优化服务、预测趋势和辅助决策。这种能力的背后隐藏着三重主要风险。

是隐私侵蚀与监控过度的问题。AI能够通过公共数据实现精准的个人追踪和行为分析,若无严格规范,可能演变为无处不在的监控工具,削弱公民自由,破坏社会信任基础。马斯克曾公开表示,无约束的AI监控能力可能催生“数字极权”的阴影,这并非杞人忧天。

是数据偏见与系统歧视的放大。公共数据往往反映现实社会中的既有偏见,如种族、性别或经济地位的不平等。若AI算法未经审慎设计和持续矫正,便会在自动化决策中固化甚至加剧这些不公,例如在执法预警、信贷评估或招聘筛选等领域,导致系统性歧视,威胁社会公平与稳定。

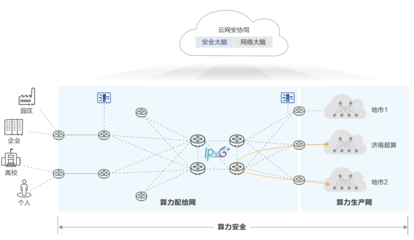

是安全漏洞与恶意利用的隐患。集中化的公共数据池成为吸引黑客和敌对势力的高价值目标。一旦AI系统本身被攻破或误导,可能引发从大规模个人信息泄露到关键基础设施瘫痪的连锁危机,如智能电网、交通信号或应急响应系统的故障,直接危及公共安全。

面对这些挑战,马斯克及许多科学家呼吁构建“安全优先”的AI发展框架。这包括推动透明可解释的算法设计,建立强有力的数据治理和隐私保护法律,以及发展AI安全研究,例如确保系统对齐人类价值观、防止自主武器滥用等。公共数据的收集与使用必须遵循最小必要原则,并接受民主监督和伦理审查。

跨界合作至关重要。政策制定者、技术开发者、伦理学家和公众需共同参与对话,制定全球性的准则与标准,以避免恶性竞争导致安全底线失守。正如一些专家所指,人工智能不应是黑箱中的神秘力量,而应是服务于人类福祉、增强社会韧性的工具。

埃隆·马斯克与科学界的警告,敲响了在人工智能时代捍卫公共安全秩序的警钟。我们正站在十字路口:是通过前瞻性治理引导AI向善,还是放任其在数据洪流中失控?答案取决于今天的选择——唯有将安全、公平与责任置于创新核心,才能确保技术进步真正照亮而非阴影笼罩人类的未来。

如若转载,请注明出处:http://www.91qianmei.com/product/13.html

更新时间:2026-03-08 00:37:34